Wesentliche Erkenntnisse

- Die EU-KI-Verordnung klassifiziert KI-Systeme in vier Risikokategorien: verbotene Praktiken, Hochrisikosysteme, KI mit Transparenzpflichten und KI-Modelle für allgemeine Zwecke (GPAIs).

- Anbieter von Hochrisiko-KI-Systemen müssen Konformitätsbewertungen durchführen, Risikomanagementsysteme implementieren, Datenqualität sicherstellen, technische Dokumentation führen und die Leistung nach der Bereitstellung überwachen.

- Das Gesetz weist je nach Rolle unterschiedliche Compliance-Verantwortlichkeiten zu: Anbieter tragen die größte Last, während Nutzer für rechtmäßige Verwendung und menschliche Aufsicht sorgen müssen.

- Wichtige Compliance-Fristen sind bereits in Kraft, wobei Vorschriften für verbotene Praktiken ab Februar 2025 und das Hauptregime für Hochrisikosysteme ab August 2026 gelten.

Hier ist, was Sie wirklich wissen müssen, um konform zu bleiben 👇

Was ist die EU-KI-Verordnung?

Die EU-KI-Verordnung ist der weltweit erste umfassende rechtliche Rahmen für künstliche Intelligenz.

Ihr Grundprinzip ist unkompliziert: Die Regeln, die für ein KI-System gelten, hängen vom potenziellen Schaden ab, den es verursachen könnte.

Ein Chatbot für den Kundenservice unterliegt anderen Verpflichtungen als ein KI-Modell, das Stellenbewerber prüft oder entscheidet, wer einen Kredit erhält. Die Verordnung teilt KI-Systeme in vier Kategorien ein:

- 1. Verbotene Praktiken. Anwendungen, die vollständig verboten sind, wie manipulative Systeme, die auf gefährdete Gruppen abzielen, bestimmte biometrische Überwachungstools und soziale Bewertungsmechanismen.

- 2. Hochrisikosysteme. KI, die in den Bereichen Beschäftigung, Bildung, Strafverfolgung, Bonitätsbewertung, Versicherung und anderen sensiblen Bereichen eingesetzt wird, in denen Entscheidungen das Leben von Menschen direkt beeinflussen.

- 3. Systeme mit Transparenzpflichten. KI mit spezifischen Offenlegungspflichten, wie Chatbots, die sich als nicht-menschlich identifizieren müssen, oder Deepfake-Generatoren, die synthetische Inhalte kennzeichnen müssen.

- 4. KI-Modelle für allgemeine Zwecke (GPAIs). Foundation Models mit eigenen Dokumentations-, Urheber- und nachgelagerten Transparenzanforderungen.

Das Gesetz zieht auch eine klare Linie zwischen zwei Arten von Akteuren. Ein Anbieter ist das Unternehmen, das ein KI-System entwickelt und auf den Markt bringt. Ein Nutzer ist die Organisation, die dieses System in ihren Betriebsabläufen einsetzt. Ein HR-Software-Anbieter und das Unternehmen, das diese Software zum Screening von Lebensläufen nutzt, tragen unterschiedliche rechtliche Lasten. Diese Unterscheidung zieht sich durch jeden Abschnitt der Verordnung.

Compliance-Zeitplan

Die Einführung erfolgt gestaffelt, und einige Verpflichtungen sind bereits aktiv:

- Februar 2025. Verbotene Praktiken und Anforderungen an KI-Kenntnisse gemäß EU-KI-Richtlinie.

- August 2025. Governance-Strukturen und GPAI-Verpflichtungen.

- August 2026. Hauptregime für Hochrisiko-KI (Konformitätsanforderungen gemäß EU-KI-Richtlinie 2026).

- August 2027. Eingebettete Systeme in regulierten Produkten.

Teams, die für die Konformitätsanforderungen gemäß EU-KI-Richtlinie 2026 planen, sollten die August-Frist als harte Grenze betrachten.

Prüfen Sie den vollständigen Zeitplan der KI-Verordnung in einem anderen Blogbeitrag von aqua.

Während Sie die Komplexität der EU KI-Verordnung Compliance Anforderungen bewältigen, wird eines klar: nachvollziehbare QA und umfassende Dokumentation sind der Schlüssel zur Compliance. Genau hier bietet aqua cloud, eine KI-gestützte Test- und Anforderungsmanagementlösung, außergewöhnlichen Wert. Mit seinem domänentrainierten KI-Copilot hilft aqua Ihrem Team, Compliance-Dokumentation zu automatisieren und zu verbessern, wobei RAG-Technologie verwendet wird, die KI-Vorschläge in Ihrem spezifischen Kontext und Ihren Anforderungen verankert. Die eingebaute Rückverfolgbarkeit zwischen Anforderungen, Risiken und Testfällen schafft einen kontinuierlichen Prüfpfad, der den Anforderungen der EU-KI-Verordnung an technische Dokumentation und Aufzeichnungen entspricht. Mit der automatisierten Testfallerstellung, die regulatorische Anforderungen berücksichtigt, kann Ihr Team die systematische Validierung erreichen, die Hochrisiko-KI-Systeme erfordern. Aqua integriert sich auch mit Tools, die Ihr Team bereits verwendet, einschließlich Jira, Azure, Selenium, GitHub und 12+ weiteren Tools aus Ihrem Technologie-Stack, sodass Compliance-Workflows in Ihre bestehenden Prozesse passen.

Erreichen Sie Wettbewerbsvorteile mit aquas KI-gesteuertem Testmanagement.

Warum die EU-KI-Verordnung eingeführt wurde

KI-Systeme begannen, Entscheidungen in der realen Welt zu treffen, die grundlegende Rechte betrafen: wer eingestellt wird, wer für Wohnraum qualifiziert ist und wer von den Strafverfolgungsbehörden markiert wird. Bestehendes Recht konnte nicht Schritt halten. Die DSGVO adressierte einige Datenschutzrisiken, konnte aber Genauigkeit, Robustheit oder Erklärbarkeit nicht regulieren. Produktsicherheitsvorschriften deckten bestimmte Kategorien ab, waren aber nicht für Software konzipiert, die nach der Bereitstellung lernt und sich verändert.

Die EU-KI-Verordnung füllt diese Lücke mit einem einheitlichen, risikobasierten Rahmen und klarer Verantwortlichkeit über die gesamte KI-Lieferkette hinweg. Wenn ein KI-System Schaden verursacht, kann Ihr Anbieter nicht den Daten die Schuld geben. Ihr Nutzerteam kann nicht behaupten, es habe nicht verstanden, wie es funktionierte. Jeder Teilnehmer in der Kette hat definierte Verpflichtungen, und das Gesetz hält jeden von ihnen an diese Verpflichtungen.

Für Ihr QA-Team ist dieser Kontext wichtig. Testen geht nicht mehr nur darum zu überprüfen, ob ein System wie beabsichtigt funktioniert. Ihr Team hilft zu beweisen, dass es unter den vom Gesetz festgelegten Bedingungen sicher, fair und transparent funktioniert.

Wer muss die EU-KI-Verordnung einhalten

Wenn Ihr KI-System in der EU verwendet wird oder wenn Ihr Unternehmen KI-Tools für EU-basierte Benutzer bereitstellt, fallen Sie in den Geltungsbereich. Die Verordnung gilt unabhängig davon, wo Ihr Hauptsitz ist. Ihre Compliance-Verpflichtungen hängen dann von Ihrer Rolle ab.

Anbieter haben die höchsten Anforderungen. Dies sind Unternehmen, die KI-Systeme entwickeln, auf den Markt bringen oder unter ihrem eigenen Namen in Betrieb nehmen. Ihre Verantwortlichkeiten als Anbieter umfassen:

- Sicherstellen, dass das System alle technischen Anforderungen erfüllt

- Durchführen von Konformitätsbewertungen

- Erstellen und Pflegen technischer Dokumentation

- Betreiben von Überwachungssystemen nach der Markteinführung

Zusammengenommen definieren diese Verpflichtungen den gesamten Umfang der Anforderungen gemäß EU-KI-Richtlinie für KI-Systeme mit hohem Risiko, die Ihr Anbieterteam vor der Markteinführung erfüllen muss.

Nutzer sind Organisationen, die KI-Systeme in ihren Betriebsabläufen einsetzen. Ihr Team als Nutzer muss das System nicht neu aufbauen oder beweisen, dass es technischen Standards entspricht. Allerdings müssen Sie:

- Die Anweisungen des Anbieters zur Verwendung befolgen

- Das Verhalten des Systems in Ihrem spezifischen Kontext überwachen

- Menschliche Aufsicht qualifizierten Personen zuweisen

- In vielen Fällen vor der Bereitstellung eine Folgenabschätzung für Grundrechte durchführen

- Betroffene Mitarbeiter informieren, wenn KI am Arbeitsplatz eingesetzt wird

- Betroffenen Personen bei Bedarf KI-gestützte Entscheidungen erklären

Importeure, Händler und autorisierte Vertreter haben leichtere, aber dennoch durchsetzbare Verpflichtungen. Importeure überprüfen, ob Anbieter ihre Compliance-Pflichten erfüllt haben, bevor sie ein System in die EU bringen. Händler prüfen, ob Dokumentation, CE-Kennzeichnung und Registrierung vorhanden sind. Wenn Ihr Team ein Hochrisiko-KI-System wesentlich modifiziert oder dessen beabsichtigten Zweck ändert, können Sie gemäß dem Gesetz vom Nutzer zum Anbieter werden.

Für QA-Experten prägen diese Unterscheidungen direkt Ihre Teststrategie. Das Testen eines firmeneigenen KI-Tools, das Ihr Unternehmen entwickelt hat, ist eine Anbieter-Aufgabe. Die Bewertung eines KI-Produkts eines Drittanbieters für die Beschaffung ist eine Nutzer-Aufgabe. Die Anforderungen gemäß EU-KI-Richtlinie für KI-Systeme mit hohem Risiko verschieben sich entsprechend.

Wichtige Anforderungen gemäß EU-KI-Richtlinie

Die Compliance-Verpflichtungen gemäß der EU-KI-Verordnung variieren je nach Risikoniveau, Rolle und Einsatzkontext. Für Hochrisiko-KI-Systeme sind die Anforderungen detailliert und über den gesamten Produktlebenszyklus hinweg durchsetzbar.

Risikomanagement- und Governance-Anforderungen

Risikomanagement gemäß der EU-KI-Verordnung ist ein kontinuierlicher Prozess, keine Checkliste vor dem Start. Wenn Ihr Team Hochrisiko-KI anbietet, müssen Sie ein Risikomanagementsystem einrichten und pflegen, das:

- Bekannte und vernünftigerweise vorhersehbare Risiken identifiziert

- Die Schwere und Wahrscheinlichkeit dieser Risiken bewertet

- Kontrollmaßnahmen zur Reduzierung oder Beseitigung ergreift

- Das System neu bewertet, wenn es modifiziert wird oder wenn der Einsatz in der realen Welt neue Probleme aufdeckt

Die Verordnung behandelt Risikomanagement als gesetzliche Anforderung, da KI-Systeme schädliche Ergebnisse produzieren können, selbst wenn sie genau wie konzipiert funktionieren. Ein Einstellungstool könnte qualifizierte Kandidaten aus unterrepräsentierten Gruppen konsequent herausfiltern. Ein Kreditmodell könnte im Durchschnitt gut funktionieren, aber für bestimmte demografische Segmente versagen.

Für Ihr QA-Team müssen Testpläne risikobasierte Softwaretests, Bias-Erkennung, Edge-Case-Validierung und Szenarioanalysen umfassen, die atypische Eingaben abdecken. Governance-Strukturen sind genauso wichtig. Ihre Engineering-, Rechts-, Compliance- und QA-Teams müssen während der gesamten Entwicklung zusammenarbeiten.

Anbieter bleiben während des gesamten Lebenszyklus verantwortlich, auch nach der Bereitstellung. Wenn ein Risiko nach dem Start auftritt, kann Ihr Team die Verantwortung nicht an den Nutzer abgeben.

Speziell für EU Anhang IV benötigen Sie technische Dokumentation, die Ihre Systemarchitektur, Trainingsdaten, Leistungsmetriken und Maßnahmen zur menschlichen Aufsicht abbildet. Die meisten GRC-Tools können verfolgen, ob Sie diese Dokumente haben, können sie aber nicht erstellen.

Low-Description-1495

https://www.reddit.com/r/cybersecurity/comments/1r3lg8e/comment/o9110o2/

Datenqualität und Daten-Governance-Verpflichtungen

Daten sind eine Compliance-Variable gemäß der EU-KI-Verordnung. Hochrisiko-KI-Systeme müssen mit Datensätzen entwickelt und validiert werden, die:

- Relevant für den beabsichtigten Zweck sind

- Repräsentativ für die Bevölkerung oder Bedingungen sind, denen das System begegnen wird

- Frei von Fehlern sind, die die Ausgaben beeinflussen könnten

- Vollständig genug sind, um eine zuverlässige Leistung zu unterstützen

Ihr Team muss dokumentieren, woher die Daten stammen, wie sie gesammelt wurden, welche Vorverarbeitung angewendet wurde und ob sie Edge-Cases und unterrepräsentierte Gruppen abdecken. Für QA-Experten schafft dies eine direkte Testverantwortung: Validierung der Datenqualität, nicht nur des Modellverhaltens. Sie müssen bewerten, ob Ihre Testdatensätze die Produktionsbedingungen widerspiegeln und ob sie aktualisiert werden, wenn sich die Bedingungen der realen Welt ändern.

Wenn Ihr Team Eingabedaten für ein Hochrisiko-KI-System bereitstellt, wie z.B. das Hochladen von Kandidatenprofilen in ein KI-Screening-Tool, müssen diese Daten für den beabsichtigten Verwendungszweck relevant und ausreichend repräsentativ sein. QA-Experten auf der Nutzerseite sollten die Validierung von Eingabedaten als Compliance-Checkpoint behandeln, nicht als Vorverarbeitungsdetail.

Technische Dokumentation und Aufzeichnungspflichten

Die Anforderungen an die technische Dokumentation gemäß EU-KI-Richtlinie für Hochrisikosysteme sind spezifisch. Ihre Dokumentation muss detailliert genug sein, damit Regulierungsbehörden die Einhaltung bewerten und Nutzer die Fähigkeiten und Einschränkungen des Systems verstehen können. Sie muss abdecken:

- Den beabsichtigten Zweck des Systems und Designentscheidungen

- Quellen der Trainingsdaten und Governance-Praktiken

- Modellleistungsmetriken und Validierungsergebnisse

- Umgesetzte Risikominderungsmaßnahmen

- Ergebnisse der Konformitätsbewertung

Hochrisiko-KI-Systeme müssen außerdem automatisch Protokolle erstellen und aufbewahren, die relevante Ereignisse, Entscheidungen und Eingaben während des Betriebs erfassen. Wenn ein KI-System eine Entscheidung trifft, die jemandem schadet, müssen Regulierungsbehörden und betroffene Personen rekonstruieren können, was passiert ist. Ohne Protokolle ist diese Rekonstruktion nicht möglich.

Für Ihr QA-Team entstehen daraus zwei Verantwortlichkeiten. Erstens, validieren Sie, dass Protokollierungsmechanismen tatsächlich funktionieren: bestätigen Sie, dass das System die richtigen Informationen erfasst, sicher speichert und abrufbar macht. Zweitens, behandeln Sie Ihre Testergebnisse und Validierungsaufzeichnungen als Compliance-Nachweis. Testpläne, Testfälle, Ergebnisprotokolle und Fehlerverfolgung werden alle Teil des Prüfpfads, nicht nur interne Projektartefakte.

Anforderungen an die Transparenz gemäß EU-KI-Richtlinie und Erklärbarkeit

Die Anforderungen an die Transparenz gemäß EU-KI-Richtlinie operieren auf zwei Ebenen.

Anbieter-zu-Nutzer-Transparenz erfordert, dass Ihr Team den Nutzern die Informationen zur Verfügung stellt, die sie benötigen, um das System rechtmäßig zu betreiben. Dazu gehören:

- Gebrauchsanweisungen, eine Beschreibung der Fähigkeiten und Einschränkungen

- Betriebsbedingungen, unter denen das System wie erwartet funktioniert

- Maßnahmen, die Nutzer ergreifen müssen, um konform zu bleiben

Nutzer-zu-Benutzer-Transparenz erfordert, dass Personen, die von KI-gesteuerten Entscheidungen betroffen sind, informiert werden. Wenn KI in einem Arbeitsplatzkontext verwendet wird, müssen betroffene Mitarbeiter vor der Bereitstellung informiert werden. Wenn das System Ergebnisse liefert, die zu Entscheidungen mit rechtlichen oder erheblichen Auswirkungen auf jemanden führen, muss dieser Person mitgeteilt werden, dass KI beteiligt war. In bestimmten Fällen haben sie Anspruch auf eine Erklärung, wie das System zu seinem Ergebnis gekommen ist.

Die Erklärbarkeitsanforderungen gemäß EU-KI-Richtlinie bedeuten, dass Erklärungen für Nicht-Experten verständlich sein müssen, während sie den Entscheidungsprozess des Systems genau wiedergeben. Ihr QA-Team muss validieren, dass Erklärungsmechanismen existieren, Ausgaben in einfacher Sprache produzieren und die Argumentation des Systems genau darstellen. Technisch korrekte Erklärungen, die ein Nicht-Experte nicht interpretieren kann, entsprechen nicht dem Gesetz. Das Verständnis der Grenze zwischen Privatsphäre vs. Vertraulichkeit bei Sicherheitstests ist hier ebenfalls relevant, da Erklärbarkeitsausgaben oft personenbezogene Daten berühren, die Ihr Team sorgfältig behandeln muss.

Maßnahmen zur menschlichen Aufsicht

Hochrisiko-KI-Systeme müssen so konzipiert und eingesetzt werden, dass qualifizierte Personen eine sinnvolle Aufsicht ausüben können. Dies ist eine operative Rolle mit Autorität und realen Prozessen dahinter.

Für Ihr Anbieterteam bedeutet das, Aufsichtsmechanismen in das Design des Systems einzubauen:

- Präsentation von Ausgaben in einer Weise, die menschliche Überprüfung ermöglicht

- Bereitstellung ausreichender Kontextinformationen, damit der Aufseher versteht, was das System tut

- Ermöglichung für den Aufseher, Ausgaben bei Bedarf außer Kraft zu setzen oder rückgängig zu machen

Für Ihr Nutzerteam besteht die Verpflichtung darin, bestimmten Personen die Aufsicht zuzuweisen, sicherzustellen, dass diese Personen für die Rolle ausgebildet und ausgestattet sind, und ihnen die Befugnis zum Handeln zu geben. Aufsicht kann kein Abstempelungsprozess sein. Die menschliche Rolle muss substantiell sein.

Aus QA-Sicht ist die menschliche Aufsicht eine testbare Bedingung. Kann der zugewiesene Aufseher die Informationen sehen, die er benötigt? Kann er rechtzeitig eingreifen, um Schaden zu verhindern? Hat er die Werkzeuge, um nach seinem Urteil zu handeln? Wenn Ihre Tests ergeben, dass Aufseher Ausgaben nicht verstehen oder das System in Grenzfällen nicht außer Kraft setzen können, ist das eine Compliance-Lücke, die vor der Bereitstellung behoben werden muss.

Sicherheitsanforderungen gemäß EU-KI-Richtlinie: Genauigkeit, Robustheit und Cybersicherheit

Hochrisiko-KI-Systeme müssen eine dokumentierte Leistung erbringen, die für ihren Zweck relevant ist. Wenn Ihr System ein bestimmtes Genauigkeitsniveau beansprucht, müssen Sie es unter Bedingungen nachweisen, die den realen Einsatz widerspiegeln, einschließlich Tests mit repräsentativen Daten und Validierung der Leistung über demografische Untergruppen hinweg.

Robustheit erfordert, dass das System unter verschiedenen Bedingungen zuverlässig funktioniert, einschließlich Grenzfällen und unerwarteten Eingaben. Für Ihr QA-Team bedeutet Robustheitstests, das System mit verrauschten Daten, unvollständigen Eingaben und gezielten Adversarial Examples zu belasten. Das System muss sicher versagen, wenn die Bedingungen nicht ideal sind, nicht nur gut funktionieren, wenn sie es sind.

Die Sicherheitsanforderungen gemäß EU-KI-Richtlinie schreiben Schutzmaßnahmen vor, die den Risiken entsprechen, denen Ihr System ausgesetzt ist, einschließlich:

- Kontrollen gegen unbefugten Zugriff

- Verhinderung von Datenvergiftung

- Schutz vor Modelldiebstahl

- Abwehr von feindlicher Manipulation, wie Prompt Injection oder Modellinversion

Sicherheitstests müssen Teil Ihres Validierungsprozesses sein. Es ist eine funktionsübergreifende Verantwortung, die Ihr QA-Team einschließt, nicht etwas, das am Ende eines Freigabezyklus an ein separates Sicherheitsteam übergeben wird.

Überwachung nach der Markteinführung und Berichterstattung über Vorfälle

Die Einhaltung endet nicht mit der Bereitstellung. Anbieter von Hochrisiko-KI müssen Systeme zur Überwachung nach der Markteinführung einrichten, die:

- Die tatsächliche Systemleistung kontinuierlich verfolgen

- Auftretende Risiken in der Produktion identifizieren

- Bei Problemen Korrekturmaßnahmen auslösen

- Schwerwiegende Vorfälle den Behörden melden

Ein schwerwiegender Vorfall ist einer, der zum Tod, zu schweren Gesundheitsschäden, zu schweren Sach- oder Umweltschäden oder zu einer schweren Verletzung von Grundrechten führt. Wenn ein solcher Vorfall auftritt oder mit Ihrem KI-System in Verbindung gebracht wird, sind Sie gesetzlich verpflichtet, ihn zu melden. Das erfordert eine Compliance-Pipeline von der Erkennung über die Untersuchung und Behebung bis zur behördlichen Benachrichtigung.

Ihr Nutzerteam hat eine parallele Verpflichtung. Wenn Ihr Team einen schwerwiegenden Vorfall identifiziert oder vermutet, dass das System nicht konforme Ausgaben produziert, müssen Sie den Anbieter und in einigen Fällen direkt die Behörden informieren. QA-Experten auf der Nutzerseite benötigen Produktionsüberwachungsprozesse, Benutzer-Feedback-Schleifen und kontinuierliche Validierung, dass sich das System in Ihrem spezifischen Kontext wie erwartet verhält.

Teams, die sich auf die EU-KI-Verordnung vorbereiten, verwenden oft eine Kombination: GRC für Kontrollen, KI-Governance-Tools für Lebenszyklusartefakte und einen definierten Prozess, der sie verbindet, damit Anhang IV-Berichterstattung und Bias-Überwachung verteidigbar sind.

Brave-Culture1587

Posted in

Reddit

Compliance-Anforderungen für Hochrisiko-KI-Systeme

Hochrisiko-KI-Systeme tragen die größte Compliance-Last gemäß der EU-KI-Verordnung. Dies sind Tools, die für Beschäftigungsentscheidungen, Kreditbewertungen, Strafverfolgung, Bildung und Zugang zu wesentlichen Diensten verwendet werden. Fehler, Voreingenommenheit oder Ausfälle in diesen Kontexten können die Rechte und Chancen der Menschen direkt beeinträchtigen. Das Gesetz behandelt diese Systeme wie regulierte Produkte, und die Einhaltung geht weit über das Schreiben von gutem Code hinaus.

Konformitätsbewertungen

Bevor ein Hochrisiko-KI-System auf den Markt gebracht wird, muss Ihr Team eine Konformitätsbewertung durchführen, die nachweist, dass das System alle Anforderungen gemäß EU-KI-Richtlinie für KI-Systeme mit hohem Risiko erfüllt. Für die meisten Hochrisikosysteme können Sie diese Bewertung intern mit dokumentierten Kontrollen durchführen. Für bestimmte Kategorien, wie KI für biometrische Identifikation oder kritische Infrastruktur, verlangt das Gesetz eine Bewertung durch eine benannte Stelle.

Die Konformitätsbewertung ist kein einmaliges Ereignis. Wenn das System wesentlich modifiziert wird, in einer Weise, die seine Sicherheit, Leistung oder den beabsichtigten Zweck beeinflusst, muss Ihr Team die Bewertung wiederholen. Jedes größere Update schafft einen Compliance-Checkpoint, nicht nur die erste Bereitstellung.

Für QA-Teams bilden Ihre Testergebnisse, Fehlerprotokolle, Leistungsmetriken und Robustheitsberichte die Beweisgrundlage, die die Konformitätsbewertung ermöglicht. Wenn Sie nicht durch dokumentierte Tests nachweisen können, dass das System die Standards für Genauigkeit, Robustheit und Risikomanagement erfüllt, kann die Bewertung nicht fortgesetzt werden. Rechtliche, Engineering-, Data Science- und QA-Teams tragen alle zum Evidenzpaket bei.

CE-Kennzeichnung und Registrierungspflichten

Sobald ein Hochrisiko-KI-System seine Konformitätsbewertung bestanden hat, muss Ihr Team:

- Eine EU-Konformitätserklärung erstellen

- Die CE-Kennzeichnung am System oder in der Begleitdokumentation anbringen

- Das System in der EU-Datenbank für Hochrisiko-KI-Systeme registrieren

Die CE-Kennzeichnung signalisiert Behörden und Benutzern, dass das System die gesetzlichen Anforderungen erfüllt. Bei softwarebasierten KI-Systemen erscheint sie typischerweise in der Dokumentation, in Benutzeroberflächen oder in Begleitmaterialien. Die Registrierung in der EU-Datenbank gibt Regulierungsbehörden und der Öffentlichkeit Einblick darin, welche Hochrisiko-KI-Systeme eingesetzt werden, von wem und zu welchem Zweck.

CE-Kennzeichnung und Registrierung sind die letzten Schritte im Compliance-Prozess vor der Markteinführung. Ihre Testdokumentation ist Teil des Prüfpfads, der die CE-Kennzeichnung unterstützt.

Laufende Überwachung und Systemaktualisierungen

Nach der Bereitstellung muss Ihr Team die Systemleistung weiterhin überwachen, Risiken identifizieren, die aus der realen Nutzung entstehen, und das System aktualisieren, um die Einhaltung aufrechtzuerhalten. Dazu gehören:

- Verfolgung des Verhaltens über verschiedene Anwendungsfälle und Benutzerpopulationen hinweg

- Überwachung der Drift in der Modellleistung im Laufe der Zeit

- Reaktion auf Benutzerfeedback, Vorfallsberichte und regulatorische Leitlinien

- Bewertung, ob Änderungen die Compliance beeinflussen, und Ergreifen von Korrekturmaßnahmen

Systemaktualisierungen schaffen einen Compliance-Checkpoint. Selbst kleinere Updates müssen bewertet werden, um zu bestätigen, dass sie keine neuen Risiken einführen oder die Genauigkeit, Robustheit oder Transparenz beeinträchtigen. Tests nach der Bereitstellung sind Teil des Compliance-Lebenszyklus für Ihr Team, kein optionales Extra.

Ihr Nutzerteam muss ebenfalls aktiv überwachen, auf Anzeichen achten, dass das System nicht wie beabsichtigt funktioniert, schwerwiegende Vorfälle dem Anbieter melden und die Verwendung des Systems einstellen, wenn Ausgaben gegen das Gesetz oder die Anweisungen des Anbieters verstoßen.

Wer ist verantwortlich für die Einhaltung der EU-KI-Verordnung?

Die Compliance gemäß der EU-KI-Verordnung ist auf mehrere Akteure verteilt. Niemand kann die Verantwortung vollständig an jemand anderen abgeben.

Anbieter tragen die Hauptverantwortung. Ihr Team ist für das Design, den Aufbau, die Validierung und die Überwachung des Systems während seines gesamten Lebenszyklus verantwortlich. Das Platzieren eines Hochrisiko-KI-Systems auf dem Markt macht Ihre Organisation rechtlich verantwortlich dafür, dass es die Standards der Verordnung erfüllt, unabhängig davon, wie Nutzer es verwenden.

Nutzer sind für die rechtmäßige Nutzung verantwortlich. Wenn Ihr Team unangemessene Daten in ein konformes System einspeist, Aufsichtsanforderungen ignoriert oder das System in einem nicht autorisierten Kontext einsetzt, haftet Ihre Organisation. Nutzer sind aktive Compliance-Teilnehmer, keine passiven Endbenutzer.

Importeure und Händler überprüfen, ob erforderliche Dokumentation, CE-Kennzeichnung und Registrierung vorhanden sind, bevor sie ein System auf den EU-Markt bringen. Wenn Ihr Team weiß oder wissen sollte, dass ein System nicht konform ist, können Sie dafür verantwortlich gemacht werden, dass es verfügbar gemacht wird.

Für QA-Experten entspricht Ihre Rolle direkt der Position Ihrer Organisation in der Lieferkette. Das Testen eines eigenen Tools, das Ihr Unternehmen entwickelt hat, bedeutet Validierung auf Anbieterebene. Die Bewertung eines Drittsystems für die Beschaffung bedeutet Verifizierung auf Nutzerebene. Compliance ist eine funktionsübergreifende Disziplin, und Ihr QA-Team sitzt im Zentrum der erforderlichen Nachweise.

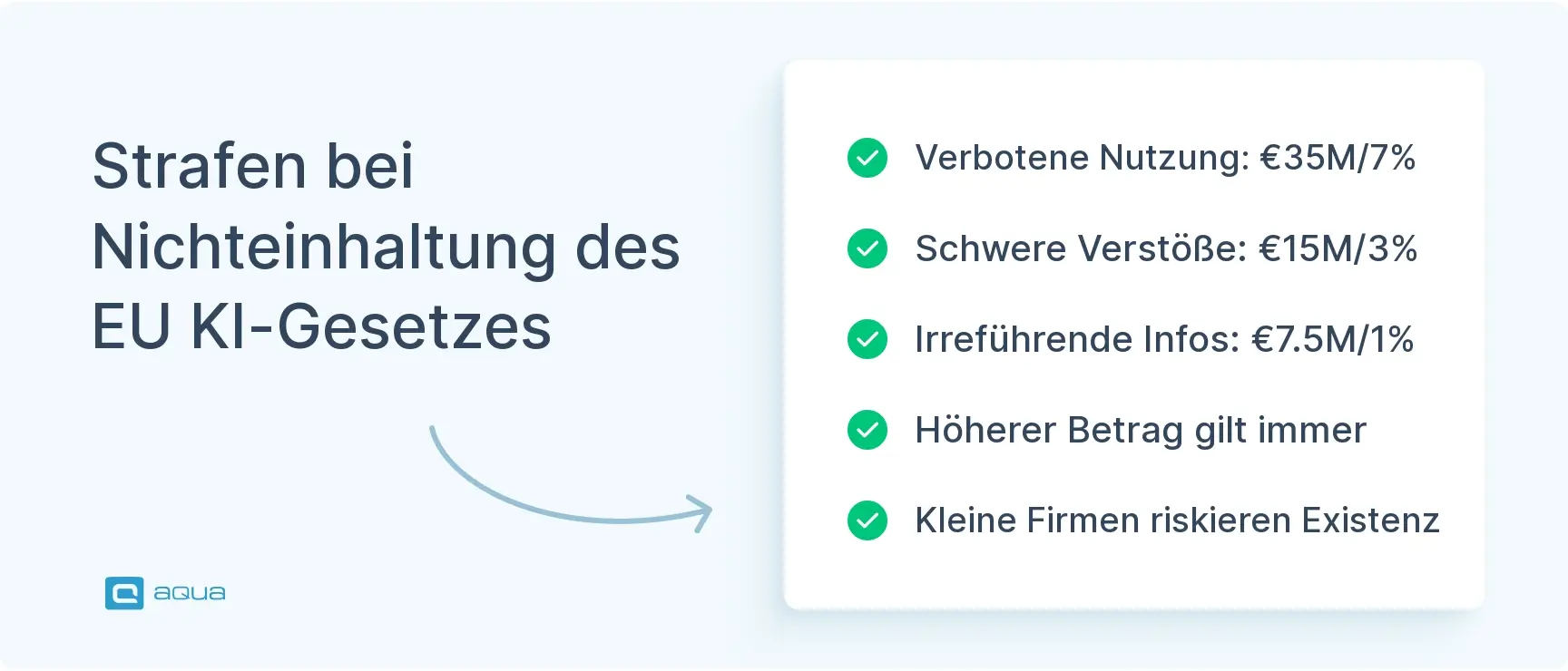

Strafen für die Nichteinhaltung der Anforderungen gemäß EU-KI-Richtlinie

Die Strafstruktur der EU-KI-Verordnung ist je nach Schwere gestaffelt:

| Art der Verletzung |

Maximale Geldbuße |

| Verbotene KI-Praktiken oder Versagen von Hochrisikosystemen |

35 Millionen Euro oder 7% des weltweiten Jahresumsatzes |

| Andere erhebliche Verstöße |

15 Millionen Euro oder 3% des weltweiten Jahresumsatzes |

| Bereitstellung falscher oder irreführender Informationen |

7,5 Millionen Euro oder 1% des weltweiten Jahresumsatzes |

In jedem Fall gilt der höhere Betrag. Für kleinere Organisationen können diese Bußgelder existenziell sein. Für große Unternehmen sind 7% des weltweiten Umsatzes ein materielles finanzielles Ereignis.

Erfahren Sie mehr über Strafen für Nichteinhaltung in einem weiteren unserer Blogbeiträge.

Finanzielle Strafen sind nicht das einzige Risiko. Eine öffentliche Feststellung, dass Ihr KI-Einstellungstool geschützte Gruppen diskriminiert hat oder dass Ihr Kreditmodell seine Konformitätsbewertung nicht bestanden hat, schafft Vertrauensschäden, die sich im Laufe der Zeit verstärken. Kunden, Partner und Regulierungsbehörden berücksichtigen alle die Compliance-Geschichte bei zukünftigen Entscheidungen.

Die Durchsetzungsinfrastruktur wird jetzt aufgebaut. Nationale Behörden richten KI-Aufsichtsgremien ein, das Europäische KI-Amt koordiniert die grenzüberschreitende Durchsetzung, und Konformitätsbewertungsverfahren werden in den Mitgliedstaaten eingeführt. Zu warten, bis die vollständige Durchsetzung ausgereift ist, bevor man handelt, ist keine tragfähige Strategie. Die Compliance-Arbeit Ihres Teams jetzt wird weitaus weniger kostspielig sein als eine spätere Sanierung unter behördlichem Druck.

Während die Durchsetzungsfristen der EU-KI-Verordnung anlaufen, benötigt Ihr Team praktische Werkzeuge, um die Einhaltung im großen Maßstab umzusetzen. aqua cloud, eine KI-gestützte Test- und Anforderungsmanagement-Plattform, ist für die spezifischen Herausforderungen der KI-Regulierung konzipiert. Seine Risikomanagement-Funktionen ermöglichen es Ihrem Team, Risiken zu dokumentieren, Maßnahmen zur Risikominderung umzusetzen und Nachweise für systematisches Testen zu erbringen: alles Anforderungen gemäß EU-KI-Richtlinie für KI-Systeme mit hohem Risiko, die Ihre Organisation erfüllen muss. Mit aquas ISO 27001-Zertifizierung und Konformität mit Standards wie DORA und DSGVO bauen Sie auf einer Grundlage auf, die bereits mit wichtigen europäischen Regulierungsrahmen übereinstimmt. Der domänentrainierte KI-Copilot von aqua verwendet die eigene Dokumentation Ihrer Organisation, um seine Ausgaben zu verankern, sodass KI-generierte Testfälle und Anforderungen für Ihren spezifischen regulatorischen Kontext relevant und genau bleiben. aqua verbindet sich mit Tools in Ihrem bestehenden Stack, einschließlich Jira, Azure DevOps und GitHub, sodass Compliance-Prozesse in die Arbeitsabläufe integriert werden, auf die Ihr Team bereits angewiesen ist.

Erreichen Sie kontinuierliche Compliance mit 97% weniger Dokumentationsaufwand mit aqua.

Fazit

Die EU-KI-Verordnung setzt konkrete, durchsetzbare EU KI-Verordnung Compliance Anforderungen für jede Organisation, die KI in Europa entwickelt oder einsetzt. Ihr QA-Team ist jetzt ein Kernbestandteil der Compliance-Funktion und erstellt die Dokumentation und Testnachweise, die von Regulierungsbehörden geprüft werden. Organisationen, die Compliance von Anfang an in ihre Entwicklungs- und Testworkflows integrieren, werden in einer stärkeren Position sein, wenn Audits beginnen.